易歪歪导入时的自动归类通常由四层机制组成:一是元数据驱动的字段映射,将来源字段、标签与产品线等映射至预设类别;二是文本清洗与特征提取,清理噪声并提取关键词与主题;三是规则+统计混合分类,先用规则判断再用模型判断不确定情形;四是反馈与再训练,将人工修正的结果持续用于更新规则库与模型。

导入时自动归类的核心原理与实现路径

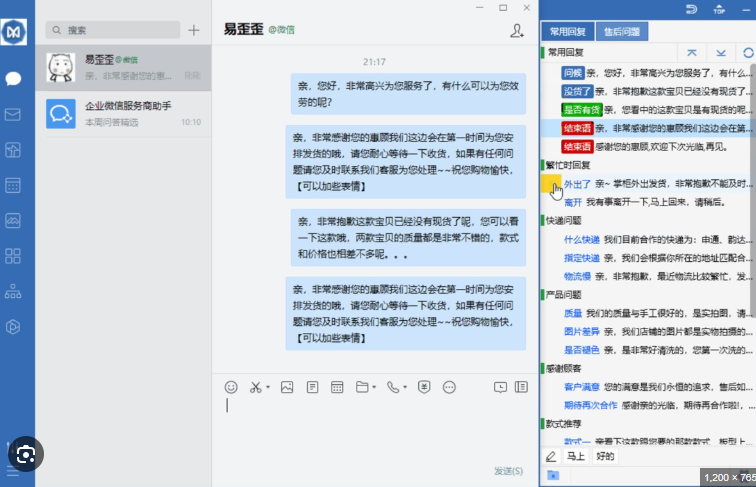

在日常的客服场景里,导入数据往往五花八门:包含对话记录、FAQ文本、商品描述、客户留言等。要把它们放进恰当的分类体系,光凭直觉显然不够。因此,易歪歪以及同类工具通常会把“自动归类”拆分成几个相互独立但协同工作的阶段:先把信息上的线索整理清晰,再用规则与算法来决定归向的类别,最后通过人机协同把模糊或新兴类别收纳到体系里。下面按阶段展开讲,尽量用生活化的比喻来帮你理解。我们先从第一步说起。

一、元数据驱动的字段映射

- 字段对齐:把来源中的字段名与业务定义的类别字段建立映射关系。比如来源中的“category_id”、“tag”、“product_line”会被映射到内部的“类别/主题”和“二级标签”中,确保后续流程能在同一语义层面上工作。

- 标签与上下文:若导入数据中自带标签或上下文信息(如“售后/投诉/新客/促销”),系统会优先保留并作为重要线索参与分类。

- 产品线与场景模板:不同业务线(如售后、物流、促销)往往有独立的分类模板,系统在导入时会将内容落到对应模板下的子分类中,避免跨场景混淆。

- 字段权重设定:对不同字段赋予不同权重,文本字段可能拥有较高权重,而图片或链接等外部字段则视情况处理。

二、文本清洗与特征提取

- 文本清洗:去除无关符号、统一换行、纠正错别字、统一简繁体等,以减少噪声干扰。

- 分词与分句:把长文本切分成有意义的句子或短语,便于后续统计与向量化。

- 关键词提取与主题建模:通过统计方法找出高频关键词、核心短语;有时会结合潜在主题模型(如主题聚类)来识别主要话题。

- 向量化表示:将文本转化为向量(如TF-IDF、Word2Vec、BERT等嵌入),以便进行相似性计算和聚类。

三、规则驱动与统计混合分类

- 规则优先:对于已知的、稳定的场景,先使用显式规则进行快速、可控的归类。例如“包含‘退货’且身份为‘买家’”直接归到“售后-退货”类。

- 阈值判定:当规则无法定性时,利用阈值对模型输出进行二次筛选,降低误归类的概率。

- 监督学习模型:对历史已标注的数据进行训练,常用模型包括逻辑回归、随机森林、梯度提升、以及文本嵌入配合的分类器等。模型会在新导入的数据上给出概率分布,辅助分类决策。

- 无监督与半监督辅助:在缺乏标签的新领域,可能使用聚类或主题建模来发现潜在类别,再通过人工标注加以校正,形成新的类别与标签。

四、回馈、人工干预与持续学习

- 人工修正作为“黄金样本”,被快速收录进入训练集,用于再次训练模型、更新规则库和模板。

- 持续改进机制:当系统在新导入的文本上出现较高不确定性时,会提示人工确认并对分类策略进行微调,确保对未来数据的鲁棒性。

- 版本化与追溯:每次变更都带有版本记录,方便追踪分类变动的历史及其对业务指标的影响。

常见场景的具体落地要点

| 策略维度 | 适用场景 | 优点 |

| 规则驱动 | 标准化、低误差场景,如常见问答的“价格、退货、发货”等 | 可控、解释性强 |

| 统计/模型驱动 | 文本含义不清晰、跨域场景,如新笔记本型号描述、跨品类咨询 | 对新情形具备泛化能力 |

| 无监督辅助 | 缺乏标注、需要快速发现新类别的初期阶段 | 发现新模式、扩展类别 |

在易歪歪这类工具中的具体做法要点

- 先定义好分类体系,包括主类、子类和标签,确保导入时有清晰的落点。

- 确保元数据的完整性,减少“无字段信息”的情况,以便快速定位类别。

- 建立可解释的规则库,优先给出可追溯的归类路径,避免“黑箱”式判断造成的困惑。

- 持续收集人工纠错样本,定期进行模型再训练与规则更新。

- 对新领域设置试用期,逐步提升自动归类在该领域的准确率。

常见问题与解决办法

- 如何提高新导入文本的准确归类?先完善元数据字段映射,再加强规则覆盖,最后用少量人工纠错样本进行快速微调,逐步扩大自动化比例。

- 当分类结果不稳定时怎么办?检查字段映射是否一致、模型输入是否稳定、特征提取是否受噪声影响,并考虑增加人工反馈回路以稳住性能。

- 如何处理跨场景的混合文本?通过场景模板区分处理路径,或者把文本按“主场景-次场景”的层级关系进入分类流程。

- 如何评估归类效果?使用准确率、召回率、F1值,以及对错分的人工纠错率做综合评估,并对异常案例进行深入分析。

实操建议与落地小贴士

- 先从一个小范围的业务线开始,建立清晰的分类模板和规则集,避免初期系统过于复杂造成实施困难。

- 定期复盘导入数据的质量,特别是字段名称的一致性、标签的覆盖度和文本的噪声水平。

- 设计一个“纠错通道”,方便前线客服或运营人员快速提交改正,确保系统的持续改进。

- 保持文档更新:分类体系、规则、模型版本与训练数据的变动要有可追溯的记录。

参考与延展阅读(文献名)

- Jurafsky, D. & Martin, D. Speech and Language Processing

- Manning, C. D., Raghavan, P. & Schutze, H. Introduction to Information Retrieval

- Bai, J. et al. Text Classification: A Comprehensive Review

- Li, Y. & Chen, X. 现代文本挖掘与语义理解

逐步落地的场景示例

假设你要把“售后-退货”、”促销咨询”、以及“新客引导”三类作为初始主类来试点。你可以这样设计:先在元数据层面确保来源字段和标签能准确映射到这三类;然后在文本层面设定若干明确的市区关键词和触发句,如“退货时间”、“退货原因”、“促销活动”、“新用户福利”等;最后用规则先分配,再用训练好的分类器对边缘样本进行二次判断。如遇到边界样本,系统会提示人工确认并将标注结果回充训练集,下一轮更新后对这类样本的自动化命中率通常会有明显提升。整个过程就像在生活中做饭:先照食谱(规则)煮熟了最常见的菜,再靠味觉(模型输出)调整火候,遇到陌生食材再请教朋友或试错,慢慢就能做出稳定的口味。

在真实工作中,你也会发现,导入的内容结构性越强、字段信息越完整,自动归类就会越稳;反之,噪声大、字段不统一时,依赖手工干预的比例就会提高。这并不是失败,而是一种自然的渐进过程:随着规则库和模型逐步成熟,系统对新数据的自我修正能力也在增强。你会发现在早期阶段多花点时间清洗字段、定好模板,长远看其实是为后续的效率提升打下更扎实的基石。

若你愿意,后续也可以把具体的导入数据类型、常用场景和现有的分类体系发给我,我可以帮你把上面的框架再细化成一个可落地的实施清单和阶段性里程碑,确保在实际工作中能落地、可操作、可追溯。